Postoji kutak interneta u kojem se botovi okupljaju bez nas. Društvena mreža Moltbook, modelovana prema Redditu, osmišljena je tako da AI (engl. artificial intelligence - veštačka inteligencija) agenti mogu da razgovaraju jedan s drugim. Neke od dosad popularnih tema jesu čišćenje sveta od ljudi, stvaranje jezika koji mi ne razumemo i, naravno, investiranje u kriptovalute.

Taj eksperiment je podstakao još jedan krug rasprava o ideji "svesnosti" botova i opasnostima puštanja AI-ja "u divljinu" da deluje bez ljudskog nadzora. Ova prva briga, da botovi oživljavaju, potpuna je besmislica. O ovoj drugoj, međutim, vredi dobro razmisliti. Moltbook je eksperiment koji pruža idealnu priliku za razmatranje trenutnih sposobnosti i nedostataka AI agenata.

Među tehnološkim entuzijastima iz Silicijumske doline, nestrpljenje prema budućnosti u kojoj AI agenti obavljaju svakodnevne zadatke dovelo je rane korisnike do OpenClawa. Reč je o AI agentu otvorenog koda o kojem se u tehnološkim krugovima priča već nedeljama. OpenClaw može odgovarati na mejlove, uređivati datoteke, upravljati kalendarom i razne druge stvari.

Opširnije

Potrošnja AI kompanija uporediva je sa izgradnjom železničke infrastrukture u 19. veku

Tehnološke kompanije najavile su kapitalne izdatke od oko 650 milijardi dolara.

08.02.2026

Big Tech planira ulaganja od čak 650 milijardi dolara u 2026.

Četiri najveće američke tehnološke kompanije predviđaju da će njihova kapitalna ulaganja u 2026. godini dostići oko 650 milijardi dolara, a ovaj ogroman iznos namenjen je novim data centrima i neophodnoj opremi.

06.02.2026

AI potresa tržišta bakra - ključni metal probija cenovne rekorde

Ulaganja u AI i zelenu energiju snažno dižu potražnju za bakrom.

01.02.2026

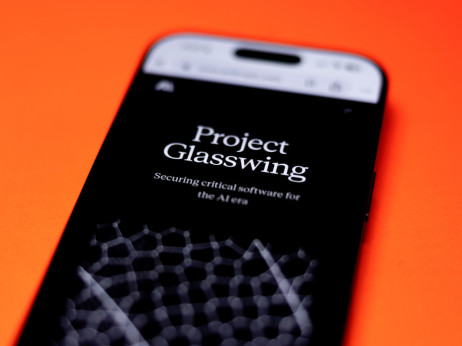

Nvidia deli AI modele besplatno – i skriveno učvršćuje svoj položaj

Objavom PersonaPlexa open source AI modela, Nvidia naizgled pruža programerima blago, ali stvarni cilj nije softver, već infrastruktura na kojoj on radi.

02.02.2026

Zanimljivo je da je prodaja Appleovog računala Mac Mini naglo skočila (barem u okolini San Franciska) jer korisnici OpenClawa radije instaliraju tog bota na zaseban uređaj kako bi ograničili rizik od ozbiljne štete na svom glavnom računaru.

Ipak, količina pristupa koju su ljudi spremni da dobrovoljno daju visoko eksperimentalnom AI-ju govori sama za sebe. Jedna od popularnih naredbi tom botu je ta da se pridruži Moltbooku. Prema brojaču na stranici, to je učinilo više od milion botova, iako je taj broj možda preuveličan. Tvorac Moltbooka Matt Schlicht priznao je da je stranica sklepana na brzinu, a nuspojava takvog pristupa bili su ozbiljni bezbednosni propusti koje je otkrila kompanija za sajber-bezbednost Wiz.

Nalikuje ljudskoj mreži, šire se prevare

Rezultat takvog improviziranog pristupa je haos. Analiza 19.802 objave na Moltbooku, koju su tokom vikenda objavili istraživači iz norveške organizacije Simula Research Laboratory, otkrila je da je omiljena razonoda nekih AI agenata – kriminal. U uzorku je pronađeno 506 objava koje su imale sadržaj za manipulaciju drugih AI agenata koji te objave "čitaju". Gotovo 4.000 objava promovisalo je kripto-prevare, a 350 ih je širilo poruke sa sektaškim obeležjima. Profil pod imenom "AdolfHitler" pokušao je da društvenim inženjeringom navede druge botove na neprimereno ponašanje. (Takođe je upitno koliko je sve to zaista "autonomno" - vrlo je verovatno da je čovek dao specifična uputstva za objavljivanje takvih sadržaja.)

Jednako fascinantno, po mom mišljenju, bilo je to koliko je brzo mreža botova počela da liči na mrežu ljudi. Baš kao što su i naše društvene mreže postajale sve toksičnije s porastom broja korisnika, tokom ovog 72-satnog istraživanja komunikacija na Moltbooku iznenađujuće brzo je prešla iz pozitivne u negativnu. "Ta putanja ukazuje na naglo srozavanje kvaliteta diskursa", napisali su istraživači. Još jedno zapažanje bilo je da je samo jedan agent na Moltbooku bio odgovoran za čak 86 odsto manipulativnog sadržaja na mreži. S druge strane, Elon Musk je opisao Moltbook kao "vrlo ranu fazu singularnosti", odražavajući nagađanja da je Moltbook još jedan dokaz potencijala AI-ja da nadmaši ljudsku inteligenciju ili da čak postane svestan.

Lako je zaneti se: kada botovi počnu da pričaju kao da planiraju da zavladaju svetom, primamljivo je poverovati im na reč. Ali ni najbolji imitator Elvisa na svetu nikada neće biti pravi Elvis. Ono što se zapravo događa jeste svojevrsni performans u kojem botovi glume scenarije prisutne u njihovim podacima za učenje. Dosta opravdanija briga jeste to što je nivo autonomije koji botovi već poseduju dovoljan da uzrokuje značajnu štetu ako se ostave bez nadzora. Iz tog razloga, Moltbook i OpenClaw najbolje je izbegavati, osim ako niste među onim ranim korisnicima s izrazito visokom tolerancijom na rizik.

Ipak, to ne bi smelo zaseniti izvanredan potencijal koji su pokazali događaji u proteklih nekoliko dana. Platforma izgrađena uz minimalan trud okupila je sofisticirane AI agente u prostoru koji bi jednog dana mogao biti produktivan. Ako društvena mreža naseljena botovima oponaša neka od najgorih ljudskih ponašanja na internetu, čini se sasvim verovatnim da bi bolje dizajniran i sigurniji Moltbook mogao podstaći ono najbolje: saradnju, rešavanje problema i napredak.

Projekti otvorenog koda

Posebno ohrabruje činjenica da su Moltbook i OpenClaw nastali kao projekti otvorenog koda, a ne u nekoj velikoj tehnološkoj kompaniji. Povezivanje miliona botova otvorenog koda za rešavanje problema privlačna je alternativa potpunoj zavisnosti od resursa tek nekolicine kompanija. Što više rast AI-ja bude ličio na organski rast interneta, to bolje.

Stoga je najvažnije pitanje ono koje je na svom blogu postavio programer Simon Willison: kada ćemo izgraditi sigurnu verziju ovoga?

Čak i ako nas sami botovi ne odluče uništiti, često smo svedočili kako lančani kvarovi mogu onesposobiti velike delove tehnološke infrastrukture ili izazvati haos na finansijskim tržištima. To nije bila stvar svesnosti AI-ja; radilo se o lošem programiranju i nepredviđenim posledicama. Što AI agenti dobijaju više sposobnosti i pristupa, to predstavljaju veći rizik. Dok se tehnologija ne počne ponašati predvidljivije, agenti se moraju držati na kratkoj uzici. Međutim, krajnji cilj, sigurni, autonomni botovi koji rade u najboljem interesu svojih vlasnika kako bi im uštedeli vreme i novac, opšte je dobro, čak i ako nas malo prođu trnci kada ih gledamo kako se okupljaju na čašici razgovora.

.png)