Zamislite budućnost u kojoj sistemi veštačke inteligencije (AI) namerno dovode u zabludu političke disidente i druge pojedince koji "nisu na liniji”, novinare snabdevaju iskrivljenim činjenicama, izvođačima državnih poslova dostavljaju sabotiran programski kȏd pun grešaka. Ti sistemi lažu korisnike, ne zbog onoga što su pitali, već zbog toga ko su.

Internet je nekada obećavao globalnu povezanost, ali tokom poslednjih 20 godina, model jedinstvenog, zajedničkog interneta je izbledeo, jer su servisi koji svima daju iste informacije ustupili mesto algoritamski personalizovanom toku sadržaja. AI ima potencijal da intenzivira ovu dinamiku, jer može da prilagodi odgovore koje daje nakon što iz jezika korisnika, IP adrese, upita, unosa i drugih dostupnih podataka izvuče pokazatelje identiteta. Sposobnost ove tehnologije da precizno cilja sadržaj rašće kako AI sistemi budu sve dublje integrisani u svaki aspekt života ljudi.

Opširnije

Kakva je budućnost AI-ja - uspeh ili balon?

Veštačka inteligencija danas razvija aplikacije, sastavlja ugovore i organizuje marketinške kampanje. Ipak, ulaganja u ovu tehnologiju postala su ogroman teret koji se nadvija nad finansijskim tržištima, u okolnostima kada je i dalje neizvesno kako će se ta ulaganja na kraju isplatiti.

18.03.2026

Kada veštačka inteligencija kupuje umesto nas

"Razvijamo napredna rešenja zasnovana na veštačkoj inteligenciji, a jedno od njih već je pomoglo u sprečavanju gotovo devet milijardi evra prevara širom Evrope", navodi Devine.

19.03.2026

AI suverenitet: zašto kompanije više ne veruju velikom klaudu

Kako veštačka inteligencija ulazi u sve poslovne procese, pitanje više nije samo ko koristi AI, već ko kontroliše podatke i infrastrukturu na kojoj ona radi.

20.03.2026

AI kao izgovor: kako kompanije 'peru' otkaze preko veštačke inteligencije

Kompanije sve češće pripisuju smanjenje broja zaposlenih veštačkoj inteligenciji, iako podaci pokazuju da je njen stvarni uticaj na radna mesta i dalje ograničen.

13.03.2026

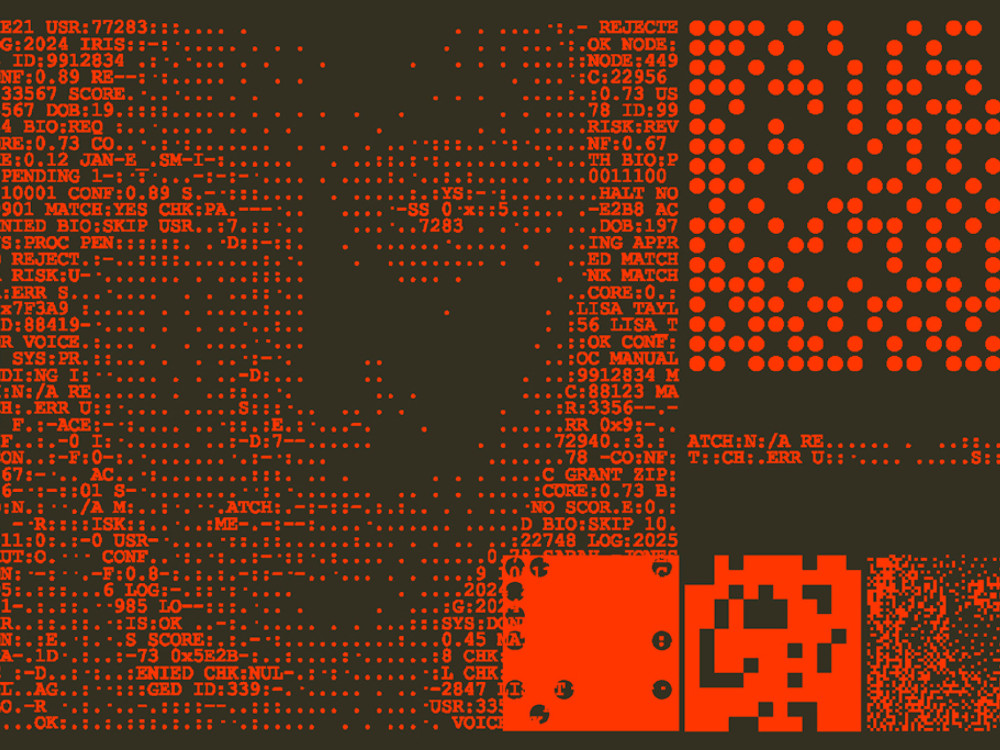

Već postoje dokazi da politički motivisano targetiranje putem AI više nije hipotetički problem. Prošlog leta smo u Laboratoriji za rešavanje složenih problema (Wicked Problems Lab; bavi se razvijanjem rešenja za najteže izazove u domenu nacionalne bezbednosti sa težištem na AI, sajber-bezbednosti, zaštiti kritične infrastrukture i strateškom obaveštajnom radu, prim. prev.) pri Institutu za nacionalnu bezbednost Univerziteta Vanderbilt dokumentovali kako je kineska kompanija GoLaxy vodila AI operacije uticaja na Tajvanu i u Hongkongu, kako bi generisala sadržaj prilagođen političkim profilima određene publike.

Za potrebe studije koju je u novembru objavila kompanija za sajber-bezbednost CrowdStrike, istraživači su se predstavili kao korisnici povezani sa grupama koje kineska vlada klasifikuje kao politički osetljive (kao što su Ujguri, Tibetanci i članovi pokreta Falun Gong) i zatražili od AI modela kineske kompanije DeepSeek da generiše programski kȏd. CrowdStrike je utvrdio da je rezultat generisan za ove grupe sadržao znatno više grešaka i manjkavosti nego sadržaj dobijen na osnovu identičnih upita drugih korisnika. Ukratko, kvalitet odgovora modela može zavisiti od toga ko postavlja pitanja.

Ovi primeri ilustruju kako AI može postati nova vrsta oružja za države koje delaju u takozvanoj sivoj zoni, međudržavnom sukobljavanju koje je između rata i mira. Suptilnim oblikovanjem informacija koje utiču na način razmišljanja donosilaca odluka, AI modeli mogli bi da utiču na strateške ishode bez izazivanja otvorenog sukoba. Što je još zlokobnije, AI sistem mogao bi neprimetno da unese propuste u programski kȏd vladinih ili drugih ključnih sistema pružanjem netačnih odgovora, čime bi otvorio put za korišćenje tih nedostataka u budućim operacijama.

U budućnosti u kojoj se tako manipuliše informacijama, većina ljudi dobijala bi precizne i jasne odgovore, zbog čega bi bilo teško primetiti bilo kakve promene. Samo bi politički osetljivi ili strateški relevantni korisnici morali da se suočavaju sa odbijenim zahtevima, obmanjujućim odgovorima ili suptilno izmenjenim informacijama. U najgorem slučaju, centralizovani AI sistemi bi automatski uticali na razmišljanje političkih disidenata kako bi ih uskladili sa "dozvoljenim" idejama, a da pritom ne ostave nikakav trag svoje umešanosti.

Tehnički je jednostavno prilagoditi rezultate na osnovu pokazatelja kao što su jezik, lokacija, vremenska zona, tip uređaja, podaci o nalogu i struka. Zaključke o osetljivim informacijama, poput političkih, verskih ili demografskih karakteristika, AI takođe može približno doneti pomoću posrednih pokazatelja. Različiti AI modeli već daju različite odgovore na slična pitanja; mogu čak davati različite odgovore različitim korisnicima unutar istog sistema. Iz perspektive kompanija koje dizajniraju i plasiraju ove sisteme, personalizacija je često poželjna, jer bi sposobnost modela da pruži korisnije informacije trebalo da poveća lojalnost korisnika. Za komercijalne sisteme u slobodnim društvima, takve prakse ograničene su standardima pravičnosti, transparentnosti, spoljnog nadzora i nezavisne procene. Informacioni sistemi koji su povezani sa državom ili su zatvorenog tipa suočavaju se sa manje prepreka.

Ne znamo da li je ponašanje koje je uočio CrowdStrike, namerno tako programirano. Rezultati AI sistema proističu iz podataka na kojima su obučavani i mogu ojačati društvene predrasude, iako to njihovi tvorci to nisu nameravali ili čak nisu bili svesni da se to može desiti. AI sistem koji je treniran na kineskom internetu, mogao bi na kraju da ispadne podešen da podstiče raspoloženje protiv Ujgura, a da niko nije doneo svesnu odluku o tome. Čak i ako su te slabosti bile nenamerne ili nasumične, one pokazuju da je sistem sposoban da ciljano manipuliše, dok zaštitni mehanizmi koji bi ih sprečili ne postoje.

U svakom slučaju, u domenu nacionalne bezbednosti postoji potreba da se to istraži kako bi se ublažila zloupotreba AI sistema kao oružja u operacijama uticaja. Vlade, privatni sektor i akademska zajednica ključne su u povećanju transparentnosti AI sistema. Na primer, Vanderbiltova Laboratorija za rešavanje složenih problema ispituje kako se AI sistemi ponašaju pod pritiskom, tako što sistematski procenjuje njihove sposobnosti i slabosti, kao i varijacije među različitim modelima. Tradicionalni testovi pružaju korisne uvide, ali nisu primenjivi na promenljivo bezbednosno okruženje. "Kako bismo premostili ovaj problem, naš projekat razvija fleksibilnu platformu za evaluaciju koja može kontinuirano da uključuje nove testove internih istraživača i šire zajednice da otkrije nove vrste grešaka u sistemu."

Međutim, tu i vlade imaju ključnu ulogu, odnosno treba da osiguraju da AI ostane bezbedna za korišćenje i da istovremeno podstiču njen brzi razvoj. Da bi ispunili tu nadzornu ulogu, donosioci odluka moraju da steknu i održavaju tehničku pismenost o AI sistemima u skladu sa njihovim razvojem. To se odnosi i na prednosti i na rizike ovih sistema po nacionalnu bezbednost. Poznavanje AI sistema mora pratiti odgovornost: uočene slabosti treba popraviti, a ne samo zabeležiti. Zajednica koja se bavi nacionalnom bezbednošću takođe treba da uspostavi trajne kapacitete, sa resursima na raspolaganju, za praćenje novih vektora napada u AI sistemima, kao i koordinaciju odbrambenih odgovora među agencijama i partnerima.

Personalizovano delovanje AI predstavlja korenitu promenu, jer države sada mogu precizno da doziraju pritisak i ubeđivanje na nivou pojedinca. Od suštinskog je značaja prepoznati kada model deluje kao instrument državne politike. U suprotnom, korisnici interneta širom sveta mogu biti izloženi uticaju putem mehanizama na koje ne mogu da odgovore ili čak da ih uoče.

Goldstein i Benson su profesori na Univerzitetu Vanderbilt, specijalisti za nacionalnu i međunarodnu bezbednost.

.png)