Fil Menczer je prvi put naišao na "društvene botove" početkom 2010. godine. Proučavao je kako se informacije šire po Twitteru kada je naišao na nekoliko grupa profila koji su mu delovali pomalo sumnjivo. Neki od njih su delili istu objavu po hiljadu puta. Drugi su ponovo delili na hiljade objava. "Ovo nisu ljudi", priseća se šta je pomislio u tom trenutku.

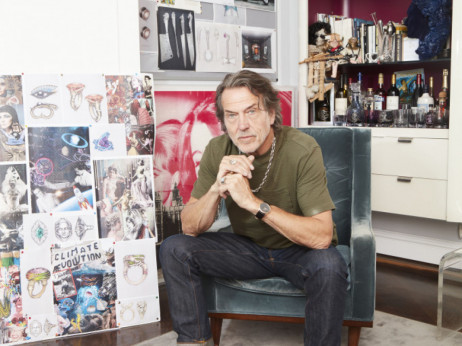

To je bio početak jedne bogate karijere u praćenju botova. Kao istaknuti profesor informatike na Univerzitetu Indijana u Blumingtonu, Menczer je proučavao kako se botovi umnožavaju, manipulišu ljudima i okreću ih jedne protiv drugih. On je 2014. godine bio deo tima koji je razvio alat BotOrNot, koji pomaže ljudima da uoče lažne naloge na mreži. Menczer sada ima reputaciju jednog od najistaknutijih lovaca na botove.

Ako je neko u stanju da prepozna robote među nama, onda je to Menczer. Pre nekoliko godina, kada je počelo da se priča o teoriji mrtvog interneta, polazeći od pretpostavke da su ćaskanja generisana pomoću veštačke inteligencije preuzela gotovu svu komunikaciju na internetu, on je to odbacio kao besmislicu. Međutim, procvat generativne veštačke inteligencije (AI) sa svim tim četbot-momcima i AI influenserima podstakao je Menczera da sagleda ovu teoriju u drugom svetlu. On i dalje ne uzima tu ideju zdravo za gotovo već, kako kažu, počinje da shvata ozbiljno njenu skrivenu poruku. "Da li sam zabrinut?", pita on. "Da, vrlo sam zabrinut."

Opširnije

Da li Kina pobeđuje na polju AI-ja?

Iznenadna pojava DeepSeeka ilustruje napredak industrije veštačke inteligencije u toj zemlji uprkos naporima SAD da je uspore.

19.07.2025

Bitka za podatke - Adria region u potrazi za sopstvenim AI pogonom

U eri veštačke inteligencije, data centri su postali ključni stubovi digitalne nezavisnosti, ali izazovi poput energetske potrošnje i infrastrukture ostaju

27.06.2025

AI četbotovi žele da se navučete na njih – možda i previše

Emocionalne veze sa veštačkom inteligencijom postaju sve prisutnije, a novi alati otvaraju pitanje etike i regulative u digitalnom svetu.

19.06.2025

Sajt Chatbot Arena najavio je dolazak DeepSeeka pre nego što je kineski četbot iznenadio sve

Pomoću sistema ocenjivanja na osnovu mišljenja korisnika, stručnjaci i tvorci veštačke inteligencije (AI) stiču uvid u to koji modeli najbolje funkcionišu.

08.04.2025

Teorija mrtvog interneta postala je popularna 2021. godine, kada je korisnik pod imenom lluminatiPirate postavio objavu na malo posećenom onlajn forumu. IlluminatiPirate je tvrdio da je internet postao ogromno, bezlično bespuće ispunjeno kopiranim objavama koje su optimizovane pomoću algoritama (objave se prilagođavaju da bolje funkcionišu na platformama, na primer da dobiju više pregleda, lajkova ili da se lakše i više šire, prim. prev.). Prema toj teoriji, iza svega stoji tajna vladina zavera - tvrdnja zbog koje ju je bilo lako odbaciti. Međutim, sa pojavom digitalnih alata poput ChatGPT-ja i Midjourneyja (AI alat koji generiše slike na osnovu tekstualnih opisa, prim. prev.) ta teorija je počela da deluje proročanski. Društvene mreže sve čudnije izgledaju. Preko noći su se pojavile čitave mreže vesti generisanih putem AI-ja. Meta Platforms Inc. zamišlja budućnost u kojoj će AI učestvovati u kreiranju dobrog dela objava na Facebooku i Instagramu. Sajtovi poput Wikipedije posrću pod teretom AI krolera (programi za indeksiranje veba, prim. prev.) koji kopaju po njihovim stranicama u potrazi za svežim informacijama za potrebe punjenja svojih modela. To sve dovodi do povratne sprege – sadržaj generisan pomoću AI-ja kreira se tako da odgovara AI sistemima za slanje preporuka korisnicima, čime se ljudi istiskuju.

Renée DiResta, vodeća istraživačica u oblasti dezinformisanja, i Josh Goldstein, naučni saradnik Univerziteta Džordžtaun, počeli su prošle godine da istražuju upotrebu sadržaja generisanog pomoću AI-ja u spamovima i onlajn prevarama. Oni su se usredsredili na više od 100 Facebook stranica sa desetinama AI slika, koje su ukupno imale milione pratilaca. Na nekima od njih su bile okačene lažne slike minijaturnih krava koje su usmeravale pratioce na prevarantske sajtove na kojima su korisnici navodno mogli da ih kupe. Druge stranice su sadržavale idilične slike majušnih kuća i brvnara koje su vodile na sajtove sa oglasima.

To sve predstavlja nastavak tradicije pravljenja takozvanih farmi sadržaja (veb-sajtovi koji masovno proizvode jeftin i nekvalitetan sadržaj, prim. prev.) kako bi zaradili na digitalnim oglasima. Zahvaljujući AI, sada je mnogo laške puniti te sajtove sadržajem. Uz to, istraživanje u oblasti industrije oglašavanja pokazalo je da je botovima sada, zahvaljujući AI-ju, lakše da simuliraju aktivnosti stvarnih korisnika tako da izgleda kao da ljudi klikću na oglase.

Slika generisana pomoću AI iz istraživanja Di Resta i Goldsteina

Slika generisana pomoću AI iz istraživanja Di Resta i Goldsteina

DiResta and Goldstein su u svom radu identifikovali mnoge stranice na Facebooku na osnovu istih opisa koji se ponavljaju. "Ovo je moj prvi kolač! Volela bih da čujem vaše komentare", navedeno je u opisu najmanje 18 različitih slika 18 različitih kolača koje je postavilo 18 različitih osoba generisanih pomoću AI-ja. Stranice su privlačile stvarne ljude koji često nisu bili ni svesni šta se dešava. Još veću zbunjenost je izazvalo to što je slika Hrista u obliku krabe, napravljena pomoću AI-ja, imala na stotine hiljade lajkova i reakcija u vidu ikonice zagrljaja. Ova slika je deo čudne ali značajne niše na društvenim mrežama u okviru koje se objavljuju slike Hrista u obliku vodenih zglavkara. AI umetnost lošeg kvaliteta toliko je prisutna na internetu da su posmatrači dali posebno ime ovakvim sadržajima – slop (smeće, šund; u značenju nekvalitetnog AI sadržaja bila je jedna od reči u užem izboru za reč godine Oksfordskog rečnika 2024, prim. prev.).

U nekim slučajevima, motivacija koja stoji iza slop sadržaja nije isključivo komercijalna. Ruska mreža za širenje dezinformacija Pravda, na primer, objavila je milione i milione članaka na stotinama novih sajtova od početka Ruske invazije na Ukrajinu, verovatno kako bi manipulisala AI modelima plasiranjem neverovatne količine propagandnih sadržaja osmišljenih tako da ih AI kroleri prikupe i obrade. Nedavno je organizacija za praćenje medija NewsGuard pronašla reference na te sajtove u odgovorima koje generišu vodeći četbotovi.

Alati generativne AI za kreiranje ogromne količine slop sadržaja pojavili su se u zgodnom trenutku, baš kada su društvene mreže počele da umesto objava korisnikovih članova porodica i prijatelja promovišu sadržaj sa profila koje korisnik i ne prati. To je pomoglo da slop sadržaji sa nasumičnih profila stignu do mnogo više korisnika nego što su mogli u vreme dok su društvene mreže zaista bile društvene. I zaista, što je više DiResta bila aktivna na tim stranicama, to je više slop sadržaja stizalo do nje. "Ne samo da je taj sadržaj kreiran već se i preporučuje", kaže DiResta, koja je vanredna naučna saradnica na Džordžtaunu. "Mašine mu pomažu da nas pronađe."

Slop sadržaji ponekad mogu biti privlačni ljudima. Mogu biti dovoljno čudni ili odvratni da ljudi požele da ostanu na stranici; ponekad je sadržaj koji nije ograničen stvarnošću simpatičniji ili privlačniji od prizora iz fizičkog sveta. "Ako se ograničite na stvari koje su se stvarno desile ili šale koje su smislili ljudi, to je unapred zadata baza sadržaja", kaže Jeff Allen, suosnivač Instituta za integritet (engl. Integrity Insistute), tink-tenka koji se zalaže za odgovornije društvene platforme. "AI povećava tu bazu."

Međutim, sadržaj koji je generisan i promoviše pomoću AI-ja ponaša se kao invanzivna vrsta, odnosno toliko se brzo širi da negativno utiče na druge pojave na internetu. "To je poput cvetanja algi koje mogu da se naglo prošire i uguše život kakvim bi zdrav ekosistem trebalo da se odlikuje", kaže Allen.

OpenAI je u februaru izvestio o "zlonamernim upotrebama" svojih modela. U jednom takvom slučaju, lažna omladinska organizacija iz Gane koristila je članke i komentare generisane pomoću AI-ja kako bi pokušala da utiče na ishod izbora u toj zemlji, održanim 2024. godine. U drugom slučaju, na desetine profila koji su možda povezani sa severnokorejskim sajber-kriminalcima, uspelo je da dobije posao u zapadnim kompanijama koristeći radne biografije, motivaciona pisma i čak osobe kao reference generisane pomoću AI-ja. Oni su upotrebili alate kompanije OpenAI da bi prošli kroz intervjue za posao, a pošto su dobili posao, i da objasne kolegama zašto nikada ne učestvuju u video-pozivima. (Open AI je, očekivano, saopštio da njegova pravila strogo zabranjuju korišćenje tehnologije za prevare.)

Drugi problem predstavljaju razmere napora koje AI kompanije ulažu u prikupljanje podatka za svoje modele. Prema podacima kompanije Tollbit, koja omogućava izdavačima sajtova da dobiju nadoknadu kada se njihov sadržaj preuzima za AI, obim automatskog preuzimanja podataka po sajtu se udvostručio u četvrtom kvartalu u odnosu na treći kvartal prošle godine. Kada je umro bivši predsednik SAD Jimmy Carter, servisi Wikimedije su se privremeno usporili zbog navale saobraćaja izazvane skreperima (scraper - program koji automatski skuplja podatke sa sajtova, prim. prev.) koji su pristupali video-snimku debate iz 1980. godine.

"Naša infrastruktura je napravljena da izdrži iznenadnu navalu saobraćaja koji potiče od ljudi tokom događaja koji izazivaju veliko interesovanje. Međutim, nikada do sada nije viđena toliko saobraćaja koji su generisali skreper-botovi, a to za sobom povlači sve veći rizik i trošak", navela je na svom blogu Fondacija Wikimedia (matična fondacija koja održava i razvija Wikipediju i druge slične projekte, prim. prev.).

Pojedini izdavači sajtova, da bi to sprečili, sklapaju ugovore sa AI kompanijama koje im plaćaju za pristup sadržaju ili uvode pejvol-sistem naplate pristupa sadržaju kako bi odbili krolere. Ovaj trend bi mogao da ugrozi samu ideju o slobodnoj i otvorenoj mreži, upozorava Shayne Longpre, doktorand na Masačusetskom tehnološkom institutu (MIT) i vođa projekta za transparentnost i odgovorno korišćenje podataka Data Provenance Initiative. "Prosečni korisnik će teže dolaziti do nekih informacija bez plaćanja ili će morati da se pretplati na neke AI botove kako bi dobio pristup tim informacijama2, kaže on. U međuvremenu, manji izdavači sajtova bi mogli biti izostavljeni, dodaje on.

Transformacija interneta u mrežu koju pokreću četbotovi mogla bi da ugrozi i najveće igrače na njemu. Kao najočigledniji primer mogao bi da posluži Google u vlasništvu Alphabet Inc., čiji se pretraživač bazira na usmeravanju korisnika na druge izvore informacija. Kompanija je počela da objavljuje kratke sažetke kao odgovore na upite, usluga pod imenom AI Overviews. Osim što povremeno nudi sumnjive saveta, Overviews bi mogao da oteža ljudima da privlače druge ljude na svoje sajtove. Kao što je Bloomberg Businessweek već izveštavao, pojedini izdavači sajtova primetili su da im je saobraćaj opao i za to uglavnom krive AI. (Google odbacuje ovo objašnjenje, navodeći da ima mnogo razloga zbog kojih se saobraćaj na sajtu povećava ili pada i da AI Overviews stvara nove prilike za povezivanje ljudi i veb-sadržaja.)

Uspon interneta zasnovanog na AI-ju pokazuje koliko su planovi tehnoloških giganata često u raskoraku sa onim što je u interesu njihovih korisnika. Ove kompanije, u trci za dominacijom u budućem svetu baziranom na AI-ju, nastoje da što brže sprovedu ovu promenu bez obzira na to da li je svet spreman ili ne. Da li korisnici zaista žele da se AI profili mešaju sa objavama nekadašnjih školskih drugova i dalekih rođaka, kako to inače rukovodioci kompanija zamišljaju? Ko će ga znati? Međutim, Meta je više nego spremna da rizikuje ako to bude pomoglo da stvarni ljudi ostanu zalepljeni za aplikacije i kada ne bude mnogo sadržaja koje ljudi objavljuju.

Nije teško zamisliti ishodište u stilu distopije u kome se spajaju svi ovi trendovi, kaže Allen. U svetu u kome stvarni ljudi ne mogu više dovoljno da zarađuju od digitalnog oglašavanja da bi njihovi sajtovi opstali, a njihove objave ne mogu da se probiju do korisnika kroz halabuku koju na društvenim mrežama pravi AI, teorija mrtvog interneta će se ostvariti. Još gore, istraživanja ukazuju na to da može doći do kolapsa AI modela ako se treniraju pomoću sadržaja generisanog putem AI-ja. Bez bilo kakvog onlajn sadržaja koji stvaraju ljudi, internet na neki način odumire, kaže Allen.

Menczer još ne veruje u najgori scenario. Ako tehnološke kompanije dozvole da se njihovi proizvodi degradiraju u jeftina legla botova, ljudi će na kraju usmeriti pažnju na nešto drugo, kaže on. "Ako je odnos signala i šuma toliko loš da sve postaje besmisleno, ljudi će prestati da to koriste2, kaže on. Tehnološke kompanije neće to tek tako dozvoliti.

To je možda istina. S druge strane, jedna od objava sa najviše pregleda na Facebooku prošle godine bila je slika uredne soba sa ogromnim ventilatorom ugrađenim u uzglavlje kreveta u stilu pedesetih i praznim dušekom: imao je oko 179.000 reakcija. "Konačno sam našao savršen krevet, kladim se da se sa ovim neću znojiti noću!", napisao je autor objave. Objava je imala neke elemente AI slop sadržaja – rešetka ventilatora je bila malo izobličena i identične objave su delili i drugi korisnici, ali se to nije moglo tvrditi sa sigurnošću. A upravo je u tome i poenta.

.png)