Rivali OpenAI, Anthropic PBC i Alphabetov Google počeli su da sarađuju kako bi pokušali da suzbiju kineske konkurente koji izvlače rezultate iz najsavremenijih američkih modela veštačke inteligencije (AI), sa ciljem da steknu prednost u globalnoj AI trci.

Kompanije dele informacije kroz Frontier Model Forum, neprofitnu industrijsku organizaciju koju su te tri tehnološke firme osnovale zajedno sa Microsoftom 2023. godine, kako bi detektovale takozvane pokušaje "destilacije" tehnologije (eng. adversarial distillation), koji krše njihove uslove korišćenja, prema izvorima upoznatim sa situacijom. Pod pojmom destilacija misli se na neovlašćeno treniranje novih AI modela na osnovu odgovora postojećih sistema.

Ova neuobičajena saradnja ukazuje na to koliko su ozbiljno zabrinute američke AI kompanije, u vezi s tim da pojedini korisnici, posebno u Kini, kreiraju imitacije njihovih proizvoda koje bi mogle da ih potkopaju cenovno i preotmu klijente, uz istovremeni rizik po nacionalnu bezbednost. Američki zvaničnici procenjuju da neovlašćena destilacija Silicijumskoj dolini donosi gubitke od više milijardi dolara godišnje, prema anonimnom, upućenom izvoru.

Opširnije

Nova pojava u kancelarijama: kolege koje sve diktiraju veštačkoj inteligenciji

Bitan napredak u AI tehnologiji za pretvaranje govora u tekst omogućava ljudima da odbace tastature i diktiraju mejlove i kôd. Međutim, da li će razgovor sa računarom na poslu ikada postati uobičajena stvar?

06.04.2026

Claude Code i velika panika oko produktivnosti 2026.

Agenti veštačke inteligencije za programiranje obećavali su da će olakšati razvoj softvera. Umesto toga, pokrenuli su grozničavu trku u kojoj se kreira i razvija po svaku cenu.

05.04.2026

Novakovićev Dash0 postao jednorog, dok AI menja infrastrukturu

Startap Dash0, koji vodi Mirko Novaković, prikupio je 110 miliona dolara u investicionoj rundi serije B i dostigao valuaciju od milijardu dolara, ulazeći u red retkih evropskih jednoroga u oblasti softverske infrastrukture.

02.04.2026

Google Stitch: sledeći korak ka svetu bez programera

Google je predstavio Stitch, alat koji omogućava da se aplikacije za dizajn kreiraju direktno iz tekstualnih upita. Ono što je nekada zahtevalo tim developera sada može da nastane u nekoliko minuta.

04.04.2026

OpenAI je potvrdio da učestvuje u razmeni informacija o destilaciji tehnologije kroz Frontier Model Forum i uputio na nedavni memorandum upućen Kongresu, u kojem je kinesku firmu DeepSeek optužio da pokušava da "besplatno koristi kapacitete razvijene od OpenAI-ja i drugih vodećih američkih laboratorija". Google, Anthropic PBC i Frontier Model Forum odbili su da komentarišu.

Destilacija je tehnika u kojoj se stariji "učitelj" (teacher) AI model koristi za treniranje novijeg "student" modela, koji replicira sposobnosti ranijeg sistema - često uz znatno niže troškove nego izgradnja originalnog modela od nule. Neki oblici destilacije su široko prihvaćeni i čak podstaknuti od AI laboratorija, na primer, kada kompanije prave manje, efikasnije verzije sopstvenih modela ili dozvoljavaju spoljnim developerima da koriste destilaciju za razvoj nekonkurentskih tehnologija.

Ipak, destilacija je postala kontroverzna kada je koriste treće strane - posebno u zemljama poput Kine ili Rusije - kako bi bez dozvole replicirale zaštićene tehnologije. Vodeće američke AI laboratorije upozorile su da bi strani akteri mogli koristiti ovu tehniku za razvoj modela bez bezbednosnih ograničenja, poput onih koja sprečavaju kreiranje smrtonosnih patogena.

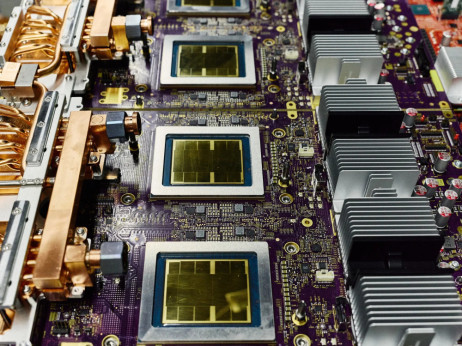

Većina modela koje razvijaju kineske laboratorije ima otvorene težine (eng. open weight), što znači da su delovi osnovnog AI sistema javno dostupni za preuzimanje i pokretanje na sopstvenim platformama, pa su samim tim i jeftiniji za korišćenje. To predstavlja ekonomski izazov za američke AI kompanije koje drže svoje modele zatvorenim, računajući na to da će korisnici plaćati pristup i time pokriti stotine milijardi dolara uloženih u data centre i drugu infrastrukturu.

Destilacija je prvi put došla u centar pažnje u januaru 2025. godine, nekoliko nedelja nakon iznenadnog lansiranja modela za rezonovanje R1 kompanije DeepSeek, koji je uzdrmao AI industriju. Ubrzo nakon toga, Microsoft i OpenAI su pokrenuli istragu da li je kineski startap nepropisno izvukao velike količine podataka iz modela američke firme kako bi razvio R1, izvestio je Bloomberg ranije.

U februaru je OpenAI upozorio američke zakonodavce da DeepSeek nastavlja da koristi sve sofisticiranije taktike za "izvlačenje" rezultata iz američkih modela, uprkos pojačanim merama zaštite. OpenAI je u memorandumu upućenom Odboru Predstavničkog doma za Kinu naveo da se DeepSeek "oslanja na destilaciju kako bi razvio novu verziju svog četbota".

Bloomberg

Bloomberg

Razmena informacija među američkim AI kompanijama o destilaciji tehnologija podseća na standardnu praksu u industriji sajber bezbednosti, gde firme redovno dele podatke o napadima i taktikama protivnika kako bi ojačale odbranu mreža. Kroz saradnju, AI kompanije pokušavaju efikasnije da detektuju ovu praksu, identifikuju odgovorne i spreče neovlašćene korisnike da uspeju.

Zvaničnici administracije Donalda Trumpa signalizirali su spremnost da podstaknu razmenu informacija među AI kompanijama, kako bi se suzbila destilacija tehnologija. Akcioni plan za veštačku inteligenciju, koji je predsednik Trump predstavio prošle godine, predviđa i formiranje centra za razmenu i analizu informacija upravo u tu svrhu.

Za sada, razmena informacija o destilaciji ostaje ograničena zbog neizvesnosti kompanija o tome šta sme da se deli u okviru postojećih antimonopolskih pravila, kako bi se odgovorilo na konkurentsku pretnju iz Kine, navode izvori upoznati sa situacijom. Kompanije bi imale koristi od jasnijih smernica američke vlade.

Destilacija je među glavnim brigama američkih AI developera otkako je DeepSeek početkom 2025. godine uzdrmao globalna tržišta lansiranjem modela R1. Izuzetno sposobni modeli otvorenog koda nastavljaju da se šire u Kini, a industrija pomno prati potencijalnu veliku nadogradnju DeepSeekovog modela.

Prošle godine Anthropic PBC je blokirao kompanije pod kineskom kontrolom da koriste njegov Claude četbot, a u februaru je identifikovao tri kineske AI laboratorije - DeepSeek, Moonshot i MiniMax - kao aktere koji nezakonito "izvlače" kapacitete modela putem destilacije. Ove godine Anthropic je upozorio da se pretnja "proteže izvan bilo koje pojedinačne kompanije ili regiona" i predstavlja rizik po nacionalnu bezbednost, jer destilovani modeli često nemaju bezbednosne mehanizme koji sprečavaju zloupotrebu AI alata.

Google je u objavi na blogu naveo da je uočio porast pokušaja izvlačenja modela. Tri američke AI laboratorije još nisu pružile dokaze koji pokazuju koliki deo kineskih inovacija u modelima zavisi od destilacije, ali ističu da se učestalost napada može meriti obimom velikih zahteva za podacima.

.png)