Otkako je Nvidia Corp. počela da dominira tržištem čipova za veštačku inteligenciju, kupci su jasno stavljali do znanja da žele da vide veću konkurenciju. Ispostavlja se da je jedna od najjačih alternativa možda sve vreme bila pred našim očima.

Google je pre deset godina predstavio svoje "tensor processing units" (TPU) čipove kako bi ubrzao svoj internet pretraživač i povećao efikasnost. Kasnije su prilagođeni za zadatke mašinskog učenja u Googleovim AI aplikacijama.

Sada kompanija sklapa velike ugovore za TPU čipove, što znači da bi mogli da predstavljaju ozbiljnu alternativu Nvidia AI akceleratorima za treniranje i pokretanje savremenih LLM modela (engl. LLM - Large Language Model - veliki jezički modeli). Ti akceleratori su u stvari GPU čipovi (engl. GPU - General Processing Unit - grafičke procesorske jedinice).

Evo više informacija o TPU-ovima, kako rade, koje su njihove prednosti i ograničenja.

Koja je razlika između GPU i TPU čipa?

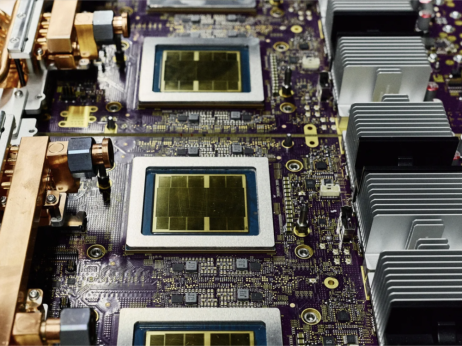

Obe vrste čipova mogu da obrađuju veliki broj računskih operacija uključenih u treniranje AI modela, ali to postižu na različite načine. Nvidia GPU čipovi prvobitno su razvijeni da obrađuju slike u video-igrama na realističan način, izvršavajući više zadataka paralelno preko hiljada računarskih "jezgara". Ova arhitektura takođe im omogućava da izvršavaju AI zadatke brzinama koje konkurentske tehnologije ne mogu da dostignu.

TPU čipovi su posebno napravljeni za tip AI zadataka poznat kao množenje matrica, glavnu operaciju u treniranju neuralnih mreža koje generišu odgovore u AI četovima kao što su OpenAI-jev ChatGPT i Anthropicov Claude.

Veliki deo tog rada uključuje ponavljajuće računice koje se obavljaju sekvencijalno, a ne paralelno. TPU-ovi su razvijeni da te zadatke obavljaju efikasno. Smatraju se manje prilagodljivim i više specijalizovanim od Nvidia GPU čipova, ali i manje energetski zahtevnim. Nvidijini GPU čipovi su fleksibilniji i lakši za programiranje, ali ta fleksibilnost može povećati troškove.

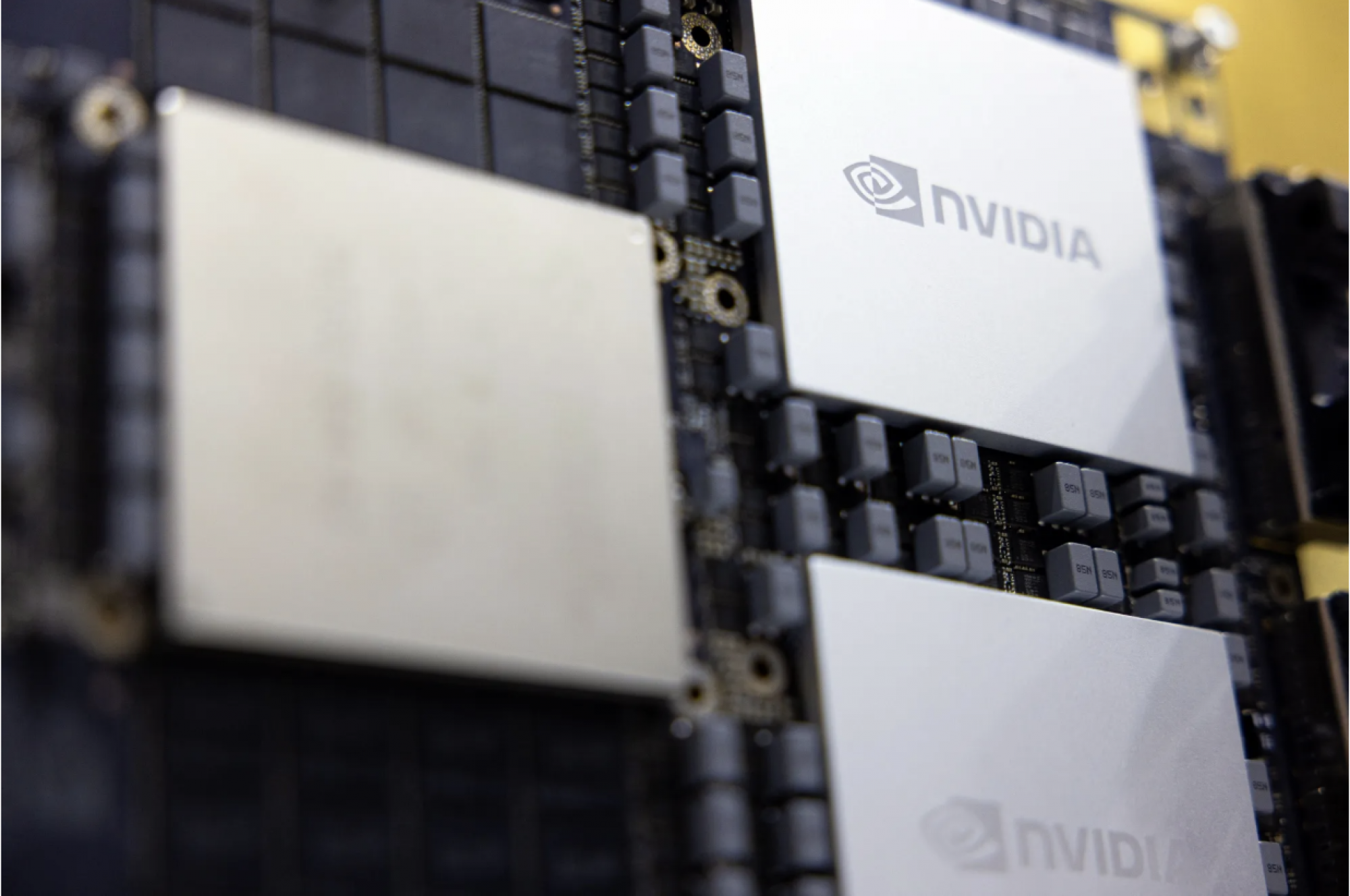

Izvor: Nvidia GB200 Grace Blackwell superčip. Fotografija: Annabelle Chih/Bloomberg

Izvor: Nvidia GB200 Grace Blackwell superčip. Fotografija: Annabelle Chih/Bloomberg

Kako su TPU čipovi postali ozbiljan konkurent u AI industriji

Google je počeo da radi na svom prvom TPU čipu 2013. godine, a objavio ga je dve godine kasnije. U početku je korišćen za ubrzavanje pretraživača i povećanje efikasnosti. Google je prvi put počeo da ugrađuje TPU-ove u svoj klaud 2018. godine, omogućavajući korisnicima da koriste usluge zasnovane na istoj tehnologiji.

Čipovi su takođe prilagođeni da podrže internu AI tehnologiju Googlea. Kako su kompanija i njen departman DeepMind razvijali napredne modele poput Geminija, mogli su da prenesu iskustva AI timova dizajnerima TPU čipova, koji su zatim mogli da prilagode čipove potrebama internih AI timova.

Najnovija verzija Googleovog TPU-a Ironwood predstavljena je u aprilu. Koristi tečno hlađenje i dizajniran je za kompleksne AI zadatke, odnosno za korišćenje već treniranih modela, a ne za njihovo treniranje. Dostupan je u dve konfiguracije: klaster od 256 čipova ili mnogo veći od 9.216 čipova.TPU-ovi mogu biti bolji od GPU čipova za određene AI zadatke jer Google može "da ukloni mnogo delova čipa" koji nisu namenjeni AI-ju, rekao je analitičar Seaporta Jay Goldberg, koji retko daje preporuku "prodati" za Nvidijine akcije. Sada u sedmoj generaciji čipova, Google je poboljšao performanse, povećao snagu i smanjio potrošnju energije, što ih čini jeftinijim za korišćenje.

Trenutni TPU korisnici uključuju Safe Superintelligence - startap koji je prošle godine osnovao suosnivač OpenAI-ja Ilya Sutskever, zatim Salesforce Inc. i Midjourney, kao i Anthropic.

Po sporazumu objavljenom u oktobru, Anthropic bi dobio pristup više od jednog gigavata Googleove računarske snage putem čak milion TPU čipova. Sledećeg meseca, The Information je izvestio da Meta Platforms Inc. razgovara o korišćenju Google TPU-ova u svojim data centrima 2027. godine.

Ovi događaji naglašavaju kako veliki AI igrači prihvataju TPU čipove dok žure da povećaju računsku moć zbog nezaustavljive potražnje.

Kakva je perspektiva za veći broj TPU prodaja

Najveći AI developeri troše desetine milijardi dolara na skupe Nvidijine čipove i žele da smanje zavisnost i ublaže posledice nedostatka, što ukazuje na veliki potencijalni tržišni prostor za TPU čipove.

Kompanije koje žele da koriste Google TPU zasad moraju da iznajme računsku snagu u Google Cloudu. To bi uskoro moglo da se promeni. Sporazum sa Anthropicom čini verovatnijim širenje u druge klaud platforme, kažu analitičari Bloomberg Intelligencea.

Niko, pa ni Google, trenutno ne pokušava da potpuno zameni Nvidijine GPU čipove; tempo razvoja AI-ja znači da to trenutno nije moguće. Google je i dalje jedan od najvećih Nvidijinih kupaca uprkos sopstvenim čipovima jer mora da zadrži fleksibilnost za klijente, rekao je Gaurav Gupta, analitičar Gartnera. Ako se algoritam ili model klijenta promeni, GPU je pogodniji za širi spektar zadataka. "Nvidia je jednu generaciju ispred industrije", rekao je portparol Nvidije. "Oduševljeni smo Googleovim uspehom, ostvarili su veliki napredak u AI-ju i nastavljamo da ih snabdevamo."

Čak i tehnološke kompanije koje nabavljaju TPU čipove i dalje dosta ulažu u Nvidijine čipove. Anthropic je, na primer, najavio veliki ugovor sa Nvidijom nekoliko nedelja nakon dogovora sa Googleom o TPU čipovima. Najbolja nada za Google TPU-ove je možda ta da će postati deo šireg paketa proizvoda potrebnih za napredak AI industrije.

.png)